Il Problema delle Azioni Cieche

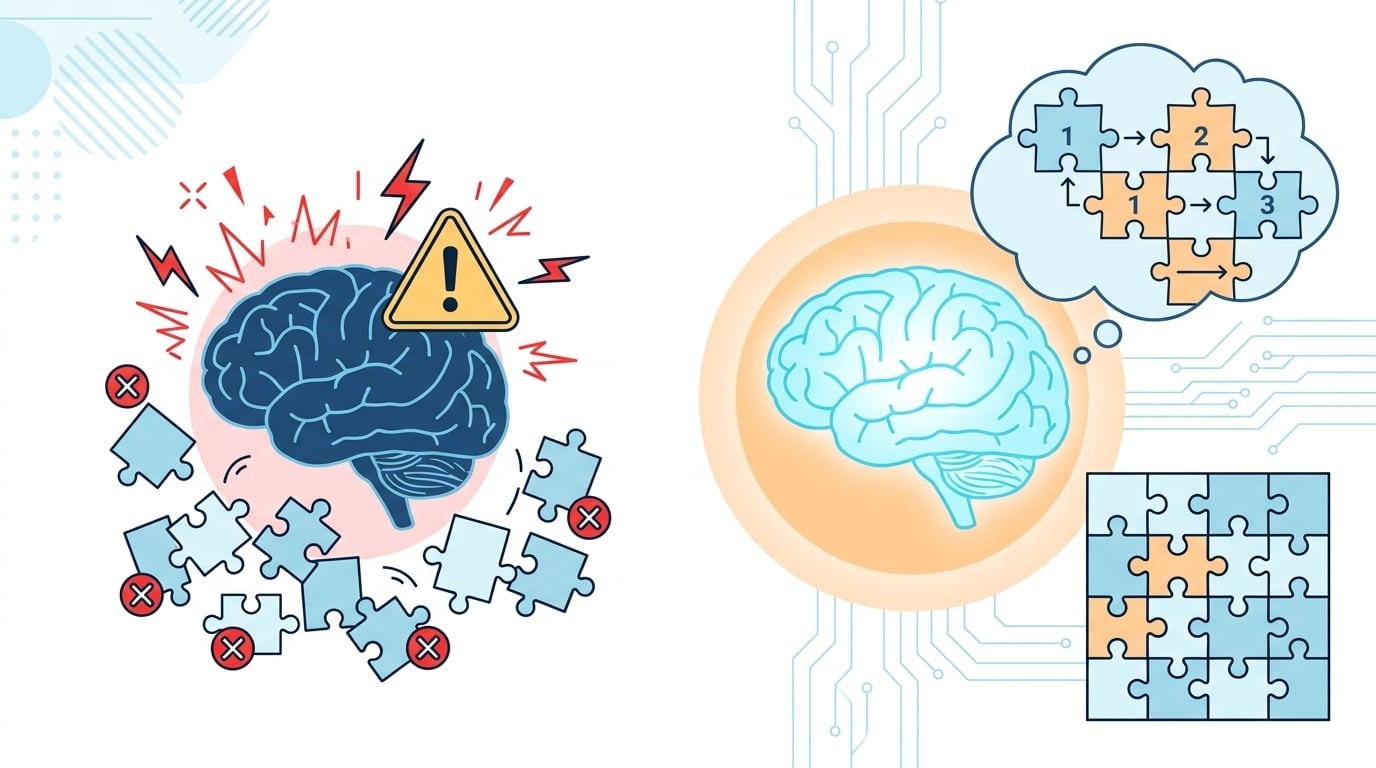

Quando si risolvono problemi logici complessi o si recuperano diverse informazioni, obbligare un'intelligenza artificiale a decidere immediatamente un'azione può portare a errori disastrosi.

Pensa come una persona risolve un puzzle:

- Non prendono semplicemente un pezzo a caso e lo infilano nel puzzle.

- Elaborano mentalmente o verbalmente una strategia: "Prima, devo trovare i pezzi con il bordo piatto per il perimetro, poi vedrò se questo pezzo blu ci sta."

Allo stesso modo, se invitiamo un'IA a solo generare un'azione—saltando la fase di ragionamento—sta agendo in modo cieco. Spesso indovinerà, farà allucinazioni o sceglierà uno strumento sbagliato perché non ha pianificato i prerequisiti necessari per rispondere alla domanda.

Ragionare ad alta voce

I modelli linguistici costruiscono la logica token dopo token. Obbligando l'IA a "ragionare ad alta voce" (generare testo che analizza il problema) prima di selezionare un'azione, le forniamo lo spazio necessario per giungere a una conclusione logica corretta.